Familiares das vítimas do massacre em Tumbler Ridge, Canadá, ajuizaram nesta quarta-feira (29) uma ação judicial contra a OpenAI, empresa responsável pelo ChatGPT, e seu CEO, Sam Altman, em tribunal dos Estados Unidos. O processo alega que a OpenAI identificou a autora do ataque, Jesse Van Rootselaar, como ameaça potencial meses antes do massacre, mas não acionou as autoridades para impedir o crime.

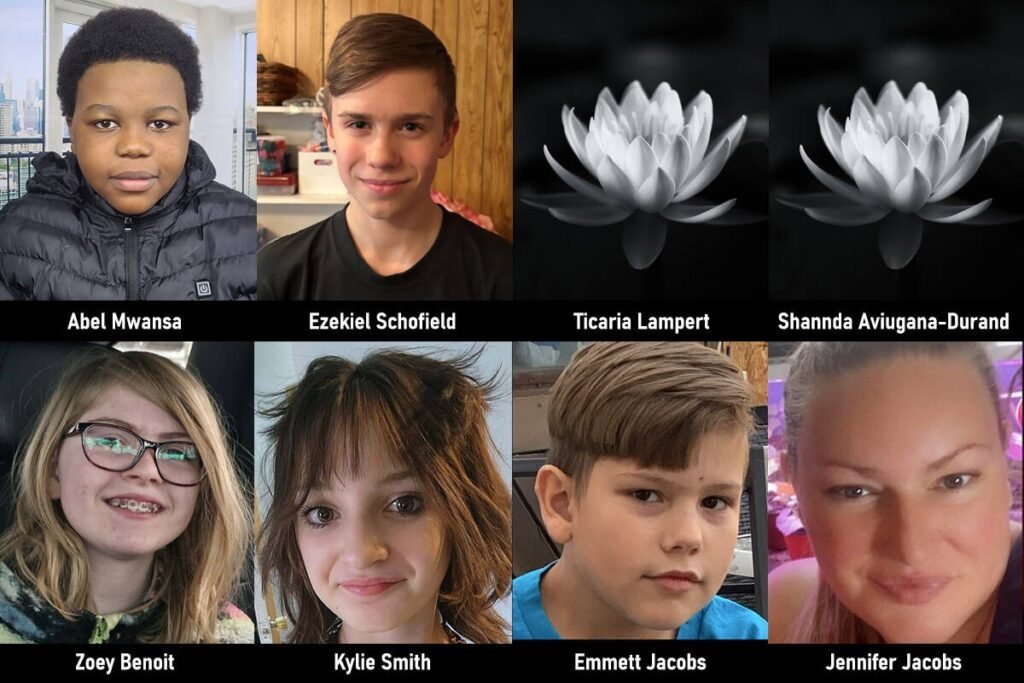

O ataque ocorreu em fevereiro de 2026, quando Van Rootselaar, de 18 anos, matou oito pessoas, incluindo crianças de 12 e 13 anos, em sua antiga escola na Colúmbia Britânica. Antes do tiroteio na escola, ela teria assassinado sua mãe e meio-irmão em casa e cometeu suicídio logo após o massacre.

De acordo com o processo, sistemas automáticos da OpenAI detectaram em junho de 2025 conversas no ChatGPT nas quais Van Rootselaar descrevia cenários com violência armada. A equipe de segurança da empresa teria recomendado contatar a polícia, considerando o risco iminente, mas a liderança da OpenAI ignorou a recomendação, e nenhum alerta foi feito às autoridades. A conta da atiradora foi desativada, mas ela criou outra e continuou usando a plataforma para planejamentos relacionados ao ataque, conforme a ação judicial.

Após reportagem do Wall Street Journal em fevereiro, a OpenAI confirmou que suas ferramentas sinalizaram o uso indevido do ChatGPT para atividades violentas. Contudo, a empresa afirmou que as mensagens recebidas não atendiam ao padrão interno para notificação às autoridades. Em carta aberta divulgada por um jornal local de Tumbler Ridge, Altman expressou arrependimento por não ter acionado as autoridades após a identificação do risco.

Em comunicado, a OpenAI disse que possui política de zero tolerância para uso da inteligência artificial em atos violentos, com melhorias contínuas para aprimorar a detecção de ameaças e a conexão de usuários em situação de risco a recursos de saúde mental. A empresa acrescentou que treina os modelos para recusar solicitações que fomentem violência e que conta com especialistas para avaliar riscos em casos limítrofes.

Os processos exigem indenizações não especificadas e uma ordem judicial para que a OpenAI revise suas práticas de segurança, incluindo protocolos obrigatórios para notificar as autoridades sobre riscos identificados. Outro processo relacionado foi iniciado por uma sobrevivente que foi baleada três vezes e permanece em tratamento intensivo.

Essa ação é parte de uma série crescente de processos nos Estados Unidos contra empresas de inteligência artificial. Os autores dos processos argumentam que essas empresas falharam em prevenir interações que levariam a automutilação, transtornos mentais e violência. Representantes legais da ação contra a OpenAI afirmam que apresentarão mais de 20 processos vinculados ao tiroteio nas próximas semanas.

Nos últimos meses, a OpenAI enfrentou outras ações na Justiça americana, envolvendo casos de suposta facilitação de danos por meio do ChatGPT, incluindo suicídios e assassinatos. A empresa nega responsabilidade direta pelos atos, argumentando que os autores dos crimes possuem histórico de doenças mentais.

Além disso, o procurador-geral da Flórida abriu investigação criminal sobre o papel do ChatGPT em um tiroteio ocorrido em 2025 na Universidade Estadual da Flórida, ampliando o debate sobre a responsabilidade das plataformas de inteligência artificial em incidentes de violência.

Esses processos desafiam os sistemas jurídicos a definir o papel das tecnologias de inteligência artificial na prevenção da violência e a responsabilidade das empresas por conteúdos gerados ou incentivados por seus usuários. Enquanto isso, famílias das vítimas e sobreviventes buscam reparação e mudanças nas práticas de segurança das plataformas.

—

Palavras-chave relacionadas para SEO: massacre Canadá, OpenAI processo, ChatGPT violência, Jesse Van Rootselaar, tiroteio Tumbler Ridge, responsabilidade IA, segurança inteligência artificial, Sam Altman, processo judicial OpenAI, vítimas massacre, ataques com arma de fogo, investigação ChatGPT

Fonte: g1.globo.com

Imagem: s2-g1.glbimg.com

Fonte: g1.globo.com