Denúncias de exploração infantil aumentam nas redes sociais

Introdução As redes sociais voltaram a ser foco de preocupação após o influenciador Felca publicar, em 6 de agosto, um vídeo que acusa outro criador, Hytalo Santos, de envolver adolescentes em conteúdos de teor sexual. Em seis dias, denúncias de exploração sexual de crianças e adolescentes nas plataformas cresceram mais de 100%, segundo levantamentos citados na imprensa. O episódio reacende…

Introdução

As redes sociais voltaram a ser foco de preocupação após o influenciador Felca publicar, em 6 de agosto, um vídeo que acusa outro criador, Hytalo Santos, de envolver adolescentes em conteúdos de teor sexual. Em seis dias, denúncias de exploração sexual de crianças e adolescentes nas plataformas cresceram mais de 100%, segundo levantamentos citados na imprensa. O episódio reacende o debate sobre por que materiais envolvendo menores continuam circulando apesar de sistemas automáticos de detecção.

Desenvolvimento

Plataformas como Instagram, TikTok e YouTube afirmam proibir e remover conteúdo que sexualize crianças e adolescentes. Elas destacam o uso de inteligência artificial para identificar imagens, textos e padrões que violem regras, além de equipes humanas para casos complexos. Ainda assim, investigadores, ativistas e influenciadores apontam que esse tipo de material segue acessível e, em alguns casos, com seções de comentários oferecendo troca de conteúdo explícito envolvendo menores.

Especialistas consultados pelo g1 atribuem a persistência do problema não à ausência de tecnologia, mas ao modelo econômico das redes, centrado em engajamento e monetização. “Todo mundo está ganhando nessa história, existe muito ganho para as plataformas, só a gente que está perdendo por ser exposto a esse tipo de conteúdo”, afirma Raquel Saraiva, presidente do Instituto de Pesquisa em Direito e Tecnologia do Recife (IP.rec). Para Maria Mello, coordenadora do Instituto Alana, “não temos a menor dúvida de que é o modelo econômico e o desenho [das redes sociais] que faz com que elas sigam, no mínimo, tolerando a circulação desse tipo de conteúdo”.

Como alternativa, Raquel propõe medidas práticas já usadas em outras frentes de moderação, como a proteção de direitos autorais: filtros automáticos poderiam impedir monetização de vídeos em que apareçam crianças, reduzindo incentivos econômicos à produção desses materiais. Plataformas dizem priorizar remoção rápida de conteúdos graves, reduzir alcance de outras violações e proibir monetização de contas de menores, segundo políticas públicas divulgadas por Meta, TikTok e YouTube.

No campo jurídico, o tema avançou no Brasil: o Supremo Tribunal Federal decidiu em junho que as redes podem ser responsabilizadas por falhas sistêmicas em remover pornografia infantil e crimes sexuais contra vulneráveis. Na Câmara, a tramitação do PL 2628/2022 voltou a ser debatida após o episódio, embora o relatório apresentado não tenha incluído o “dever de cuidado” das plataformas.

Conclusão

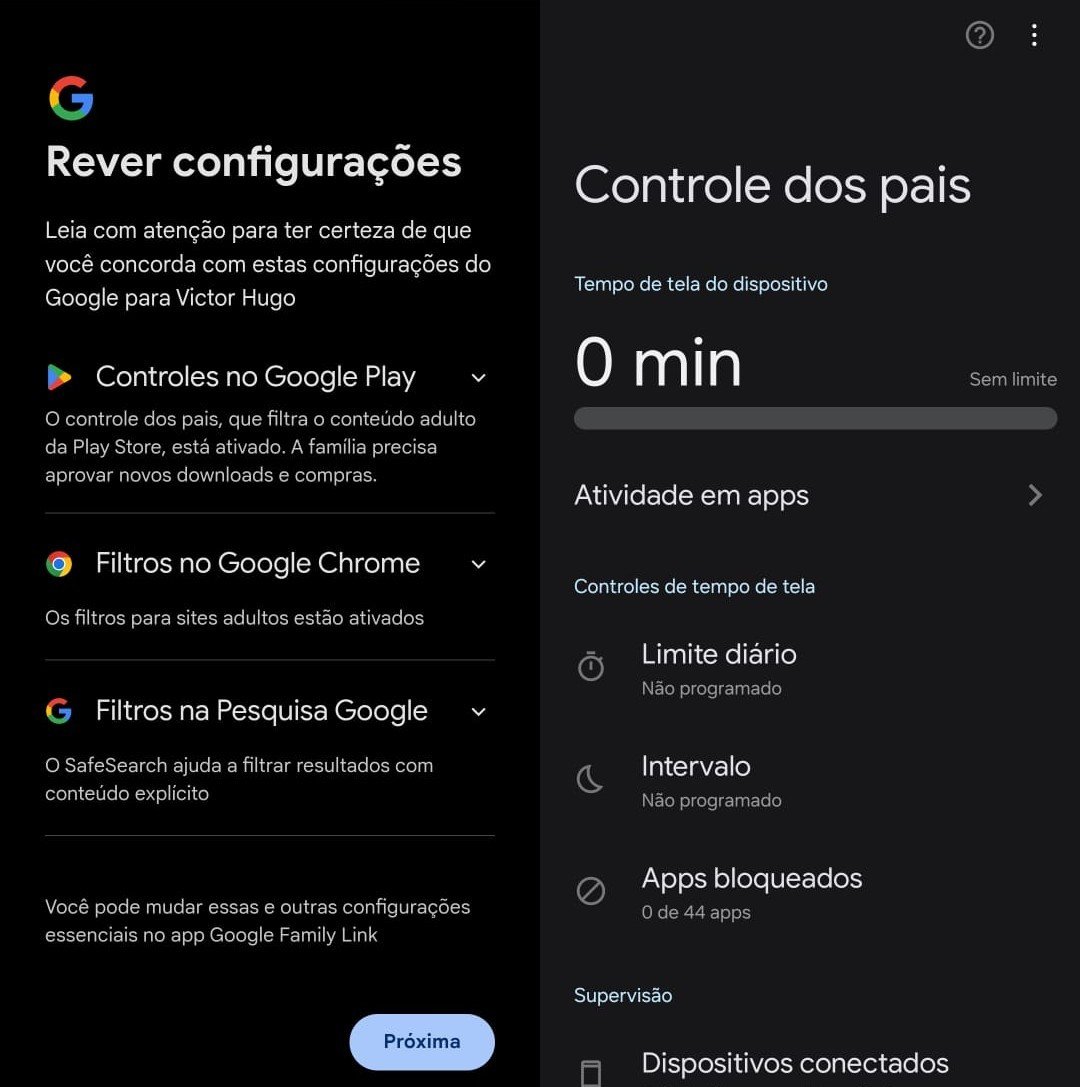

O aumento recente de denúncias mostra que a tecnologia de detecção, sozinha, não resolve o problema. Especialistas e órgãos judiciais apontam para a necessidade de combinação de ações: maior investimento das plataformas em remoção e prevenção, mudanças nos modelos de monetização que incentivam conteúdo de alto engajamento, legislações que clarifiquem responsabilidades e medidas práticas de proteção familiar. Para responsáveis por crianças, a recomendação é reduzir exposição online, usar ferramentas de controle em Android e iPhone, limitar quem pode acessar conteúdos e manter diálogo aberto com os menores para que relatem situações de risco.

Palavras‑-chave (SEO)

– exploração sexual infantil

– redes sociais e crianças

– detecção automática conteúdo

– Felca Hytalo Santos

– proteção de menores online

– moderação plataformas

– engajamento e monetização

– IP.rec Instituto Alana

– PL 2628/2022

– responsabilidade redes sociais

– como proteger crianças na internet

– controle parental Android iPhone

– pornografia infantil redes sociais

Imagem: s2-g1.glbimg.com

Fonte: g1.globo.com