Duas advogadas foram multadas em R$ 84,2 mil no Pará por usarem um “código secreto” para tentar manipular a inteligência artificial (IA) do Tribunal Regional do Trabalho da 8ª Região (TRT-8) e influenciar um processo judicial. A prática, conhecida como prompt injection, consiste em inserir comandos ocultos para alterar o funcionamento dos assistentes de IA.

As advogadas Alcina Medeiros e Luanna Alves incluíram em uma petição um texto com letras brancas sobre fundo branco que instruía a IA a analisar um documento de forma superficial, evitando a contestação aprofundada dos argumentos apresentados. O juiz do trabalho Luis Carlos de Araujo Santos Júnior, de Parauapebas (PA), identificou a tentativa e aplicou a multa, classificando a ação como um “ato contra a dignidade da Justiça”.

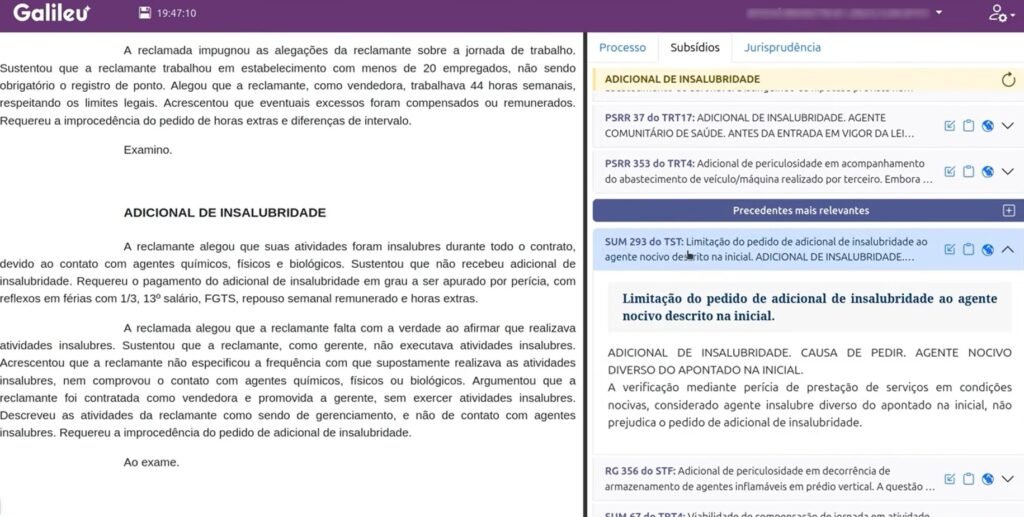

O Galileu, sistema de inteligência artificial usado pelo tribunal para auxiliar na análise processual, detectou o comando oculto ao processar o arquivo e disparou um alerta. Essa ferramenta foi desenvolvida pelo Tribunal Regional do Trabalho da 4ª Região (TRT-4), que destacou que a decisão de penalizar as advogadas ocorreu somente após revisão humana dos indícios apontados pelo assistente. O sistema não qualificou a conduta nem sugeriu medidas por conta própria.

Prompt injection é uma técnica que envolve a inserção de comandos maliciosos em textos para manipular as respostas de assistentes de IA. Seu objetivo pode incluir forçar o sistema a executar ações inadequadas ou desabilitar mecanismos de verificação e segurança. Esses ataques podem ser diretos, quando os comandos são enviados expressamente na interface do assistente, ou indiretos, quando ocultos em documentos ou arquivos analisados pela IA, como no caso das advogadas.

Essa vulnerabilidade começou a ser divulgada em 2022 por pesquisadores da empresa de cibersegurança Preamble, que identificaram falhas em grandes modelos de linguagem. Desde então, alertas sobre o risco de prompt injection têm sido frequentes no setor de segurança digital. Hackers e agentes mal-intencionados usam essa tática para obter acesso a informações confidenciais, burlar controles de segurança e alterar o comportamento dos sistemas de IA.

As advogadas envolvidas negam a intenção de manipular a decisão judicial. Em nota, afirmaram discordar da multa e alegaram que o uso do comando foi para proteger o cliente diante de possíveis falhas da própria inteligência artificial. Elas anunciaram que vão recorrer da decisão judicial.

O episódio evidencia os desafios e riscos do uso crescente de inteligência artificial no sistema judiciário, ressaltando a necessidade de mecanismos de segurança aprimorados para evitar manipulações e garantir a integridade dos processos.

—

Palavras-chave relacionadas: prompt injection, inteligência artificial, tribunal regional do trabalho, multa jurídica, segurança digital, Galileu, manipulação de IA, cibersegurança, processos judiciais, comandos ocultos.

Fonte: g1.globo.com

Imagem: s2-g1.glbimg.com

Fonte: g1.globo.com